Home » KI für Security Research: Wer darf was, und wer darf was nicht?

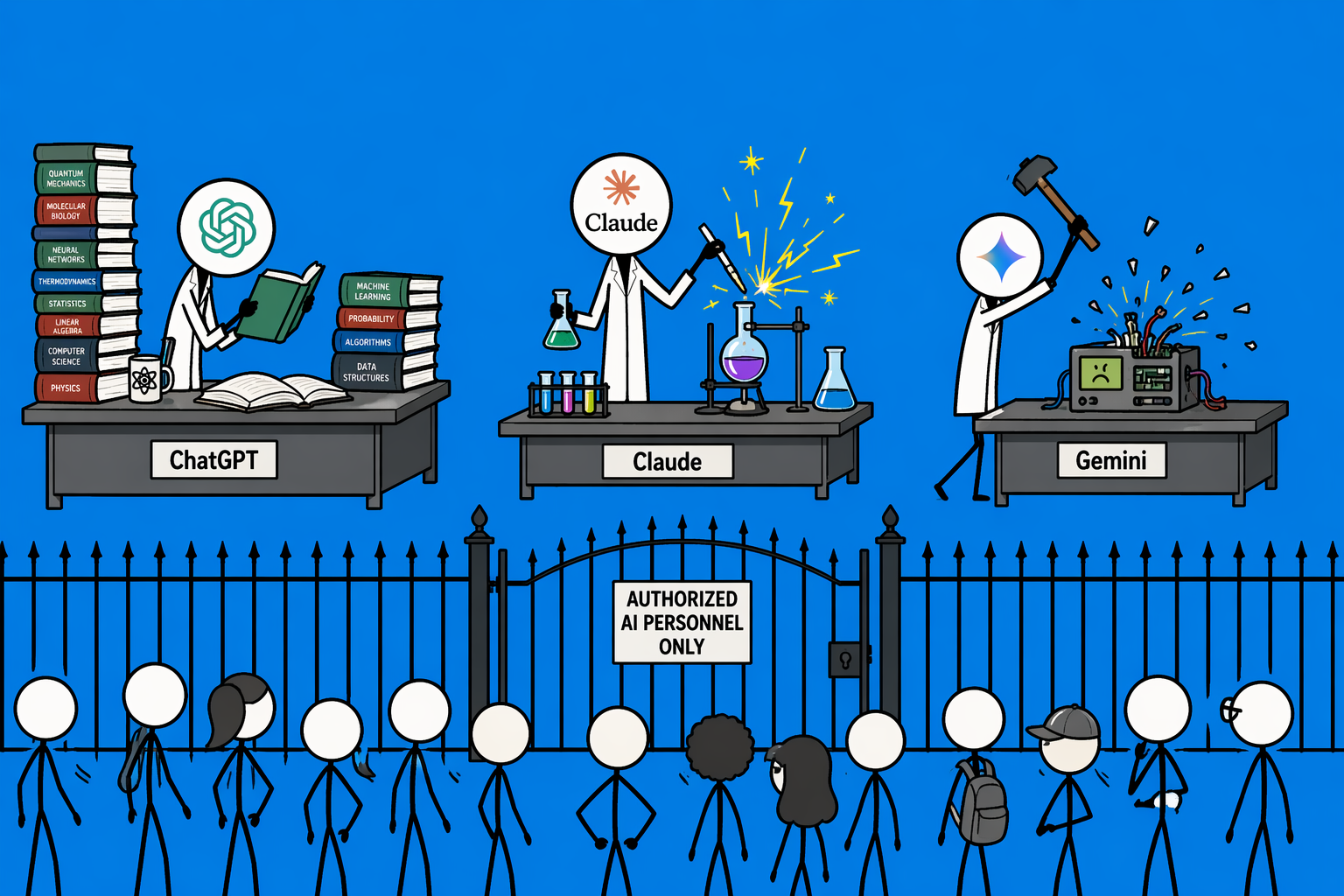

Einige Anbieter von Frontier-KI-Modellen beginnen gerade damit, ausgewählten Forschenden und Organisationen Zugang zu Modellen zu gewähren, die weit über das hinausgehen, was öffentlich verfügbar ist. Sie verändern damit die Landschaft der IT-Sicherheitsforschung. Dieser Artikel gibt einen Überblick über die aktuelle Lage und was das für die Branche bedeutet.

Den meisten in der Community dürfte Claude Mythos Preview und das dazugehörige Project Glasswing von Anthropic bekannt sein. Das Modell hat in den letzten Wochen für erhebliches Aufsehen gesorgt: Es hat in internen Tests diverse Zero-Day-Schwachstellen in gängiger Infrastruktur identifiziert, darunter in allen gängigen Betriebssystemen und Browsern. Anthropic hat das Modell bewusst nicht öffentlich veröffentlicht. Stattdessen läuft es in einem streng kontrollierten Preview-Programm, an dem rund 40 Organisationen wie AWS, Apple, Cisco, Google, und Microsoft teilnehmen.

Für normale Pentest-Unternehmen oder unabhängige Sicherheitsforschende gibt es aktuell keinen Zugang zu Mythos.

Für Sicherheitsforschende bietet Anthropic allerdings an, die Restriktionen ihrer aktuellen Modelle zu reduzieren, wenn veröffentlichte Forschung in Form von CVEs (gefundene Sicherheitslücken), Talks und Blogartikeln nachweisen kann.

Siehe https://claude.com/form/cyber-use-case

OpenAI geht einen anderen Weg. Mit dem Trusted Access for Cyber (TAC)-Programm gibt es seit Februar 2026 eine zugänglichere Option. Einzelpersonen können sich über chatgpt.com/cyber verifizieren, Unternehmen über einen OpenAI-Vertriebskontakt. Das höchste Zugangslevel schaltet GPT-5.4-Cyber frei, ein speziell für Sicherheitsaufgaben feinabgestimmtes Modell mit reduzierten Einschränkungen für legitime Forschungsarbeit, inklusive Fähigkeiten wie Binary Reverse Engineering. Das Programm soll auf Tausende von Einzelpersonen und Hunderte von Teams ausgeweitet werden.

Google bietet mit Sec-Gemini v1 ein experimentelles Modell an, das speziell für Threat Intelligence, Schwachstellenanalyse und Incident Response konzipiert ist. Der Zugang ist ebenfalls eingeschränkt und aktuell nur für ausgewählte Forschungseinrichtungen, NGOs und Sicherheitsforschende über ein Antragsformular erreichbar. Der Fokus liegt klar auf dem defensiven Bereich.

Wer die modernsten KI Modelle für seine Forschung einsetzen möchte hat heute keinen strukturierten Zugang zu diesen. OpenAIs TAC ist die einzige Option mit einem halbwegs öffentlichen Bewerbungsweg. Anthropics Glasswing ist de facto closed. Googles Sec-Gemini ist defensiv ausgerichtet und nicht für Forschung oder kommerzielle Pentest-Arbeit konzipiert.

Was bleibt, ist die gleiche Basis wie für alle anderen: die öffentlich verfügbaren Modelle mit ihren bekannten Einschränkungen.

Wer sich nicht von externen Providern abhängig machen will, findet in lokal betriebenen Modellen eine echte Alternative. Wir haben die Möglichkeiten, Grenzen und technischen Voraussetzungen dafür bereits ausführlich beleuchtet: Lokale KI in Pentesting und Sicherheitsforschung

Unabhängig davon, ob man Zugang zu diesen Programmen bekommt oder nicht, stellen sich grundlegende Fragen, die die Branche beschäftigen sollten.

Wer sich auf cloudbasierte KI-Dienste für sicherheitskritische Arbeit einlässt, macht sich abhängig. Zugangsbedingungen können sich ändern, Programme können eingestellt werden, Preismodelle können sich über Nacht verschieben. Was heute als TAC-Mitglied möglich ist, könnte morgen hinter einer neuen Zugangsschranke liegen. Für eine Dienstleistung, auf die Kunden und laufende Engagements angewiesen sind, ist das ein echtes operatives Risiko.

Wer sensible Kundendaten wie Quellcode, Netzwerkdiagramme, Konfigurationen oder Logs an einen externen KI-Dienst schickt, riskiert mehr als nur einen Vertragsbruch. Was mit diesen Daten tatsächlich geschieht, ist selbst bei gut formulierten Datenschutzrichtlinien schwer vollständig nachzuvollziehen. Werden Eingaben für zukünftige Trainingsläufe verwendet? Werden sie geloggt? Von wem kann auf sie zugegriffen werden? Diese Fragen sind für kommerzielles Pentesting und Sicherheitsforschung nicht akademischer Natur, sie sind praktisch relevant.

Das vielleicht grundlegendste Problem ist die Intransparenz. Die Kriterien, nach denen entschieden wird, wer Zugang zu diesen Modellen bekommt, sind nicht transparent. Anthropics Glasswing-Partnerliste liest sich wie ein Who’s Who der Tech-Giganten. OpenAIs TAC verspricht breiteren Zugang, aber welche Maßstäbe gelten bei der Verifizierung? Wie wird entschieden, ob ein Sicherheitsforschender oder eine Firma als „legitimer Verteidiger“ gilt?

Das ist keine abstrakte Kritik. Es geht darum, wer die Deutungshoheit darüber hat, was als verantwortungsvolle Sicherheitsforschung gilt und wer deshalb an den leistungsfähigsten Werkzeugen teilhaben darf.

Copyright Mint Secure GmbH. All Rights Reserved.